Folge 20: Technisches Onpage-GEO (Teil 1) – Crawling für KI-Systeme optimieren

Technisches Onpage-GEO bildet das Fundament für erfolgreiche Sichtbarkeit in KI-Systemen. Ohne eine solide technische Basis können selbst die besten Inhalte nicht von AI-Crawlern erfasst und verarbeitet werden. In dieser zweiteiligen Serie zeigen Maggie Mues und Franziska Schneider, wie Webseiten technisch für die neue Ära der KI-gestützten Suche vorbereitet werden.

Teil 1 konzentriert sich auf den Bereich Crawling: Von der strategischen Steuerung der AI-Bot-Zugriffe über robots.txt bis zur Optimierung von Ladezeiten und Sitemaps. Die Episode liefert konkrete Handlungsempfehlungen für die Praxis – inklusive kritischer Einblicke in die Debatte um llms.txt und die Herausforderungen für Publisher im AI-Zeitalter.

Sie sehen gerade einen Platzhalterinhalt von YouTube. Um auf den eigentlichen Inhalt zuzugreifen, klicken Sie auf die Schaltfläche unten. Bitte beachten Sie, dass dabei Daten an Drittanbieter weitergegeben werden.

Mehr InformationenInhaltsverzeichnis

ToggleTechnisches Onpage-GEO: Die Basis für AI-Sichtbarkeit

Technisches Onpage-GEO und technisches Onpage-SEO sind eng miteinander verwoben. Beide Disziplinen arbeiten am selben Arbeitsmittel – der Webseite – und setzen technische Maßnahmen an URLs, Templates und Infrastruktur um. Die zentrale Erkenntnis: Technisches Onpage-GEO ohne technisches Onpage-SEO ist nicht möglich.

Der Grund liegt auf der Hand: Das Ranking in Suchmaschinen hat nachweislich einen positiven Einfluss auf die Sichtbarkeit in vielen AI-Systemen. Wer in Google gut rankt, erhöht die Wahrscheinlichkeit, auch von KI-Systemen als relevante Quelle erkannt und zitiert zu werden. Diese Synergie macht eine isolierte Betrachtung beider Bereiche unmöglich.

Die drei Ziele von technischem Onpage-GEO

Technisches Onpage-GEO verfolgt drei strategische Hauptziele, die aufeinander aufbauen und gemeinsam die Grundlage für erfolgreiche AI-Sichtbarkeit schaffen:

Prüfung der technischen Voraussetzungen

Bevor Optimierungen greifen können, müssen die technischen Rahmenbedingungen stimmen. Eine systematische Prüfung identifiziert potenzielle Hindernisse wie blockierte AI-Bots, fehlerhafte Statuscodes oder unzugängliche Inhalte. Diese Bestandsaufnahme bildet die Grundlage für alle weiteren Maßnahmen.

Sicherstellung von Crawling & Datenverständnis

AI-Systeme müssen Inhalte zunächst finden und durchsuchen können. Die Crawling-Fähigkeit stellt sicher, dass alle GEO-relevanten Seiten für AI-Bots zugänglich sind. Gleichzeitig müssen KI-Systeme die Daten verstehen können – strukturierte Formate und maschinenlesbare Aufbereitung sind hier entscheidend.

Identifikation von Optimierungspotenzialen

Über die Grundvoraussetzungen hinaus existieren zahlreiche technische Stellschrauben, die die Performance in AI-Systemen verbessern. Von optimierten Ladezeiten über strukturierte Daten bis zu strategischen Sitemap-Strukturen – jede Optimierung erhöht die Wahrscheinlichkeit, als relevante Quelle erkannt zu werden.

Die drei Bereiche des technischen Onpage-GEO

Technisches Onpage-GEO gliedert sich in drei zentrale Maßnahmenbereiche, die jeweils spezifische Aspekte der technischen Optimierung adressieren. In dieser Folge konzentrieren wir uns auf den ersten und umfangreichsten Bereich: Crawling.

Der Crawling-Bereich stellt sicher, dass alle für GEO relevanten Inhalte einer Webseite von AI-Bots gefunden und durchsucht werden können. Dies umfasst fünf zentrale Unterthemen:

- Steuerung AI-Bot Zugriffe: Strategische Entscheidungen über robots.txt und Firewall-Einstellungen

- JavaScript-Rendering: Sicherstellung, dass kritische Inhalte ohne JavaScript verfügbar sind

- Sitemap-Organisation: Systematische Erfassung aller relevanten URLs

- HTTP-Statuscodes: Fehlerfreie Erreichbarkeit für Zitierfähigkeit

- Page Experience & Ladezeiten: Optimierung für effizientes Crawling

Discovery-Mechanismen helfen AI-Systemen, relevante Inhalte gezielt zu identifizieren und zu priorisieren. Dieser Bereich wird in Teil 2 der Serie behandelt und umfasst Strategien, wie Inhalte für AI-Systeme besonders sichtbar gemacht werden können.

Strukturierte Daten und semantisches HTML ermöglichen es AI-Systemen, Inhalte nicht nur zu finden, sondern auch korrekt zu interpretieren. Die Datenstrukturierung wird ebenfalls in Teil 2 vertieft und zeigt, wie maschinenlesbare Formate die Verarbeitung durch KI-Systeme optimieren.

Crawling-Bereich 1: Steuerung der AI-Bot-Zugriffe

Am Anfang jeder GEO-Strategie steht eine fundamentale Frage: Soll die eigene Webseite AI-Systemen das Crawling erlauben? Diese Entscheidung hat weitreichende Konsequenzen für die Sichtbarkeit in KI-gestützten Suchsystemen.

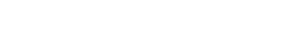

AI-Bots identifizieren und kategorisieren

Nicht alle AI-Bots verfolgen dieselben Ziele. Eine differenzierte Betrachtung ist notwendig, um strategische Entscheidungen zu treffen:

AI-Suche & Assistenten

Systeme wie ChatGPT mit Websuche, Perplexity oder Google AI Overviews crawlen Inhalte, um sie direkt in Antworten zu zitieren. Für die meisten Webseiten wird der Zugriff empfohlen, da er direkte Zuordnung und Sichtbarkeit ermöglicht – inklusive Traffic-Potenzial durch Quellenangaben.

AI-Agenten

Autonome AI-Agenten führen komplexe Aufgaben aus und interagieren mit Webseiten. Hier ist eine individuelle Bewertung notwendig – abhängig vom Website-Typ, Sicherheitsanforderungen und Geschäftsmodell. Nicht jede Webseite profitiert von Agent-Zugriffen.

LLM-Crawler (Training)

Crawler von OpenAI, Anthropic oder Google sammeln Daten für das Training von Large Language Models. Diese Bots generieren keinen direkten Traffic-Rückfluss. Die Entscheidung sollte auf Basis des eigenen Content-Geschäftsmodells getroffen werden – besonders Publisher stehen hier vor strategischen Dilemmata.

Praktische Umsetzung: robots.txt und Firewall

Die technische Steuerung erfolgt über zwei zentrale Mechanismen:

robots.txt: Hier können spezifische User-Agents von AI-Bots zugelassen oder blockiert werden. Eine differenzierte Steuerung ermöglicht es, beispielsweise ChatGPT-User den Zugriff zu erlauben, während Training-Crawler blockiert werden.

Firewall-Einstellungen: Besondere Vorsicht ist bei Cloudflare geboten. Die Einstellung „Block AI-Bots“ sperrt pauschal alle AI-Bots aus – auch jene, die für GEO-Sichtbarkeit relevant sind. Diese Einstellung sollte nur aktiviert werden, wenn bewusst auf AI-Sichtbarkeit verzichtet wird.

Praxis-Tool: AI-Bot-Analyzer

Mit dem kostenlosen Tool von Max Braglia (https://maxbraglia.com/ai-bot-analyzer) lässt sich schnell prüfen, welche AI-Bots aktuell auf eine Webseite zugreifen dürfen. Das Tool analysiert robots.txt und gibt Aufschluss über die aktuelle Konfiguration – mit dem Hinweis, dass Firewall-Einstellungen zusätzlich berücksichtigt werden müssen.

Fallbeispiel: Spiegel.de blockiert OpenAI

Ein prominentes Beispiel für die Konsequenzen von Bot-Blockierungen ist Spiegel.de. Das Portal blockiert den OpenAI-Crawler – mit direkten Folgen: Spiegel.de wird nicht als Quelle in ChatGPT zitiert und kann keinen Traffic aus diesem System generieren.

Diese Entscheidung ist für Publisher nachvollziehbar: AI-Crawler scrapen Inhalte ohne Erlaubnis oder Vergütung, berufen sich auf Fair-Use-Policies, liefern aber kaum Traffic-Rückfluss als Gegenwert. Erste Lösungsansätze wie Cloudflares „Pay-per-Crawl“ (Beta) versuchen, ein neues Geschäftsmodell zu etablieren, bei dem Urheber:innen für die Nutzung ihrer Inhalte vergütet werden.

Die andere Perspektive: AI-Crawling-Statistiken

Daten von Cloudflare Radar zeigen ein ernüchterndes Bild: Das Verhältnis von Crawling-Anfragen zu tatsächlichen Verweisen (Referrals) auf Webseiten ist extrem unausgewogen. Die meisten AI-Bot-Zugriffe dienen dem Training von Modellen – echter Traffic für Webseiten entsteht kaum.

Für Publisher ist dies ein fundamentales Problem: Traffic ist ihr Geschäftsmodell. Wenn AI-Systeme Inhalte konsumieren, aber keinen nennenswerten Traffic zurückliefern, entsteht eine wirtschaftliche Schieflage. Die Branche sucht nach Lösungen – von systemseitigen Blockierungen bis zu neuen Vergütungsmodellen.

Die llms.txt-Debatte: Hype oder Zukunft?

Ein Thema, das in der GEO-Community kontrovers diskutiert wird, ist die llms.txt – ein vorgeschlagener Standard, der Website-Inhalte im Markdown-Format speziell für Large Language Models bereitstellen soll.

Das Konzept

Die Idee hinter llms.txt ist simpel: Ähnlich wie robots.txt für Crawler bietet llms.txt eine standardisierte Datei, die LLMs optimierte, strukturierte Inhalte zur Verfügung stellt. Der Vorschlag stammt aus der Entwickler-Community und wird auf web.dev dokumentiert.

Das Problem: Keine offizielle Unterstützung

Aktuell unterstützt kein KI-Anbieter llms.txt offiziell. Gary Illyes von Google stellte klar: „Google nutzt llms.txt nicht.“ John Mueller ergänzte: „Kein AI-System nutzt oder plant dies aktuell.“

Das Paradoxon: Trotz fehlender offizieller Unterstützung haben Google, Anthropic und Cloudflare selbst llms.txt-Dateien veröffentlicht. Die Interpretation liegt nahe, dass diese Unternehmen den Standard testen – ohne ihn offiziell zu endorsen.

Unsere Einschätzung

Die llms.txt ist aktuell kein prioritäres Thema für GEO-Strategien. Solange keine offizielle Unterstützung existiert, sollten Ressourcen in bewährte Maßnahmen wie strukturierte Daten, optimierte Meta-Descriptions und semantisches HTML investiert werden. Dennoch lohnt es sich, die Entwicklung zu beobachten – Standards können sich schnell etablieren, wenn große Player einsteigen.

Crawling-Bereich 2: JavaScript-Rendering

JavaScript-Rendering ist im SEO längst etabliert – Google und andere Suchmaschinen können JavaScript-basierte Inhalte gut verarbeiten. Im GEO-Kontext müssen wir jedoch einen Schritt zurückgehen: Die meisten AI-Systeme außerhalb des Google-Universums haben aktuell Schwierigkeiten mit JavaScript-Rendering.

Warum ist das relevant?

Viele moderne Webseiten laden kritische Inhalte dynamisch per JavaScript nach. Ohne JavaScript-Rendering sehen AI-Crawler nur eine leere Hülle – die eigentlichen Inhalte bleiben unsichtbar. Während Google-basierte Systeme (inklusive AI Overviews) damit umgehen können, haben ChatGPT, Perplexity und andere Systeme hier Defizite.

Die Lösung: Server-Side Rendering oder Hybrid-Ansätze

Für GEO-kritische Inhalte sollte sichergestellt werden, dass sie auch ohne JavaScript verfügbar sind. Dies kann durch Server-Side Rendering (SSR), Static Site Generation (SSG) oder Hybrid-Ansätze erreicht werden. Die Investition lohnt sich: Inhalte, die ohne JavaScript abrufbar sind, erreichen ein deutlich breiteres Spektrum an AI-Systemen.

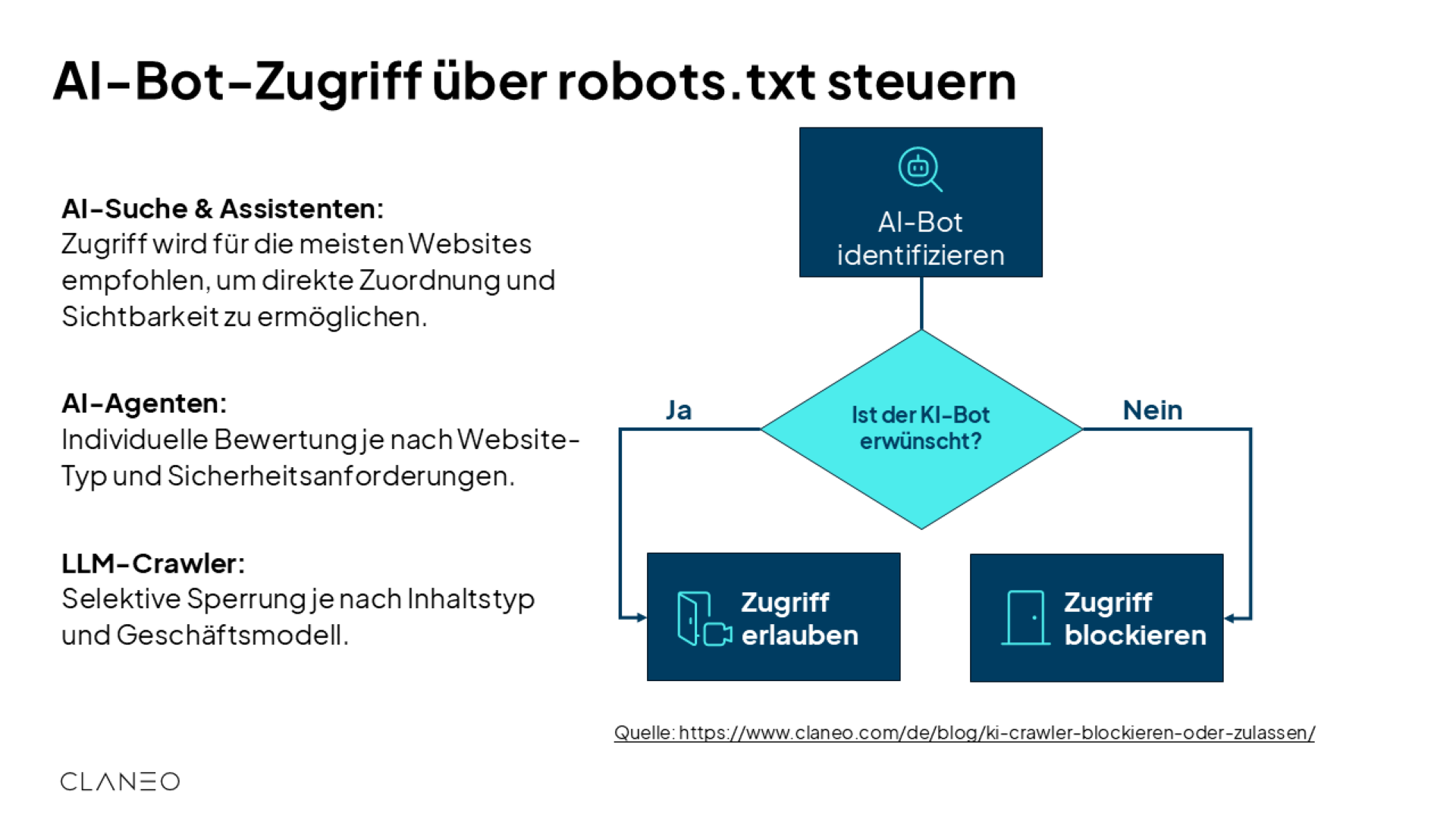

Crawling-Bereich 3: Sitemaps für systematische URL-Erfassung

Sitemaps sind ein bewährtes Instrument aus dem SEO – und ihre Bedeutung überträgt sich direkt auf GEO. Sie helfen AI-Systemen, alle relevanten URLs einer Webseite systematisch zu erfassen, ohne auf interne Verlinkung oder Zufallsentdeckungen angewiesen zu sein.

Warum Sitemaps für GEO wichtig sind

AI-Crawler arbeiten effizienzorientiert. Eine gut strukturierte Sitemap signalisiert, welche Inhalte prioritär gecrawlt werden sollten. Besonders bei großen Webseiten mit tausenden URLs ist eine Sitemap unverzichtbar, um sicherzustellen, dass GEO-relevante Seiten nicht übersehen werden.

Best Practices für GEO-Sitemaps

- Priorisierung: Nutze Priority-Tags, um GEO-relevante Seiten hervorzuheben

- Aktualität: Halte Sitemaps aktuell – veraltete URLs schaden der Crawl-Effizienz

- Segmentierung: Erstelle separate Sitemaps für verschiedene Content-Typen (Blog, Produkte, Ratgeber)

- Validierung: Prüfe regelmäßig, ob alle URLs in der Sitemap erreichbar sind (Status 200)

Crawling-Bereich 4: HTTP-Statuscodes und Zitierfähigkeit

Server-Statuscodes spielen eine kritische Rolle für die Zitierfähigkeit von URLs in AI-Systemen. LLM-Crawler müssen URLs fehlerfrei erreichen können, um sie als Quelle zu verwenden.

Der Verifikationsprozess

Wenn ein AI-System eine URL als potenzielle Quelle identifiziert, erfolgt eine Verifikation: Ist die Seite erreichbar? Liefert sie den erwarteten Inhalt? Ist eine URL im Moment der Verifikation nicht erreichbar (404, 500, Timeout), zieht das AI-System eine andere Quelle vor – selbst wenn der Inhalt ursprünglich perfekt gepasst hätte.

Kritische Statuscodes für GEO

- 200 OK: Idealer Status – URL ist erreichbar und zitierfähig

- 301/302 Redirects: Funktionieren, sollten aber minimiert werden (Crawl-Budget)

- 404 Not Found: Verhindert Zitierung – tote Links regelmäßig bereinigen

- 500 Server Error: Kritisch – signalisiert Unzuverlässigkeit

- 503 Service Unavailable: Temporäre Ausfälle können Zitierungen verhindern

Monitoring-Tools sollten regelmäßig prüfen, ob GEO-relevante URLs stabil erreichbar sind. Jede Downtime kann potenzielle Zitierungen kosten.

Crawling-Bereich 5: Page Experience und Ladezeiten

Schnelle Ladezeiten sind nicht nur für Nutzer:innen relevant – auch AI-Systeme bevorzugen performante Webseiten. Logfile-Analysen zeigen: KI-Bots rufen größere und damit langsamere URLs deutlich seltener ab.

Core Web Vitals als Orientierung

Die Core Web Vitals bieten auch für GEO wertvolle Orientierung:

- LCP (Largest Contentful Paint): Wie schnell wird der Hauptinhalt geladen?

- INP (Interaction to Next Paint): Wie reaktionsschnell ist die Seite?

- CLS (Cumulative Layout Shift): Wie stabil ist das Layout?

- FCP (First Contentful Paint): Wann erscheint der erste Inhalt?

- TTFB (Time to First Byte): Wie schnell antwortet der Server?

Seitengröße und Crawling-Frequenz

Besonders relevant für GEO: Die Seitengröße beeinflusst direkt die Crawling-Frequenz. Seiten mit mehreren Megabyte Größe werden von KI-Bots seltener abgerufen – sie verbrauchen zu viel Crawl-Budget. Optimierungen sollten sich auf folgende Bereiche konzentrieren:

- Bildkompression und moderne Formate (WebP, AVIF)

- Minimierung von CSS und JavaScript

- Lazy Loading für nicht-kritische Inhalte

- Content Delivery Networks (CDN) für schnellere Auslieferung

- Server-Response-Optimierung

Zusammenfassung: Crawling als Fundament für GEO-Erfolg

Technisches Onpage-GEO beginnt mit der Sicherstellung, dass AI-Systeme Inhalte überhaupt finden und durchsuchen können. Die fünf Crawling-Bereiche bilden das Fundament:

1. AI-Bot-Zugriffe steuern

Strategische Entscheidungen über robots.txt und Firewall-Einstellungen treffen. Differenziert zwischen AI-Suche, Agenten und Training-Crawlern unterscheiden.

2. JavaScript-Rendering optimieren

Kritische Inhalte ohne JavaScript bereitstellen, um maximale Kompatibilität mit allen AI-Systemen zu gewährleisten.

3. Sitemaps strukturieren

Alle relevanten URLs systematisch in Sitemaps erfassen und priorisieren, um effizientes Crawling zu ermöglichen.

4. Statuscodes überwachen

Fehlerfreie Erreichbarkeit sicherstellen – nur stabil verfügbare URLs können zitiert werden.

5. Performance verbessern

Ladezeiten und Seitengröße optimieren, um Crawling-Frequenz zu erhöhen und Crawl-Budget effizient zu nutzen.

In Teil 2 dieser Serie werden wir die Bereiche Discovery und Datenstrukturierung vertiefen – und zeigen, wie strukturierte Daten, semantisches HTML und Shopping-Feeds die Verarbeitung durch AI-Systeme optimieren.