Folge 22: Grounding, RAG und Query-Fan-Out – Wie KI-Systeme Webdaten nutzen

KI-Modelle generieren Antworten auf Basis von Wahrscheinlichkeiten, doch wie werden daraus verifizierbare, quellenbasierte Fakten? Die Antwort liegt in den technischen Mechanismen, die hinter jeder KI-Antwort ablaufen.

In dieser Folge zeigen Martin Grahl und Chris Hoogeveen, wie KI-Systeme durch Grounding, RAG (Retrieval-Augmented Generation) und Query-Fan-Out aus wahrscheinlichen Antworten verifizierbare Fakten machen. Wer verstehen will, wie ChatGPT, Gemini und Perplexity externe Quellen einbinden und welche Implikationen das für GEO-Strategien hat, findet hier das technische Fundament.

Sie sehen gerade einen Platzhalterinhalt von YouTube. Um auf den eigentlichen Inhalt zuzugreifen, klicken Sie auf die Schaltfläche unten. Bitte beachten Sie, dass dabei Daten an Drittanbieter weitergegeben werden.

Mehr InformationenInhaltsverzeichnis

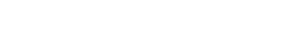

ToggleKlassische Suche vs. KI-Suche: Der fundamentale Unterschied

Um zu verstehen, warum Grounding überhaupt notwendig ist, müssen wir den grundlegenden Unterschied zwischen klassischer Suche und KI-Systemen betrachten.

Klassische Suchmaschinen arbeiten deterministisch: Eine Suchanfrage wird durch einen Algorithmus verarbeitet, der auf Basis von Onpage-Signalen, Offpage-Signalen und Nutzer-Signalen einen Score berechnet. Das Ergebnis ist eine Ranking-Liste – eine wahre Aussage darüber, welche Seiten am besten zur Anfrage passen.

KI-Systeme hingegen arbeiten probabilistisch: Sie berechnen für jedes mögliche nächste Wort eine Wahrscheinlichkeit und generieren daraus eine Antwort. Das Problem: Wahrscheinlich ist nicht gleich wahr.

Das Problem: Wahrscheinlich ≠ Wahr

Ein KI-System ohne Zugriff auf aktuelle Quellen generiert Antworten ausschließlich auf Basis seiner Trainingsdaten. Bei der Frage „Was ist die beste Siebträgermaschine für Einsteiger?“ könnte das Modell eine plausibel klingende Antwort generieren – ohne Zugriff auf aktuelle Preise, Verfügbarkeit oder neue Modelle.

Die Antwort basiert auf Wahrscheinlichkeiten, nicht auf verifizierbaren Fakten. Genau hier setzt Grounding an.

Was ist Grounding?

Beim Grounding wird die Antwort eines KI-Systems an der Realität verankert. Ziel ist es, Halluzinationen zu verhindern, indem KI-Systeme ihre Aussagen auf spezifische, verifizierbare Quellen oder reale Bilddaten stützen oder erweitern, statt sie ausschließlich auf gelernten Wahrscheinlichkeiten zu basieren.

Der Prozess funktioniert in mehreren Schritten:

Das System analysiert zunächst, ob für die Beantwortung der Anfrage externes Wissen benötigt wird. Diese Entscheidung basiert auf der Tool Use Policy:

- Statisches Wissen: Fragen wie „Wann wurde Einstein geboren?“ können aus dem Modellwissen beantwortet werden ✅

- Dynamisches Wissen: Fragen wie „Was ist der aktuelle Bitcoin-Kurs?“ erfordern Live-Daten 🔄

Nur wenn das System erkennt, dass aktuelle oder verifizierbare Informationen notwendig sind, wird der Grounding-Prozess aktiviert.

Sobald feststeht, dass externe Quellen benötigt werden, entscheidet das System über die Query-Strategie:

Exact Prompt: Die Query wird exakt wie eingegeben verwendet. Dies kommt zum Einsatz bei sehr spezifischen Signalen, Fehlercodes, Artikelnummern oder exakten Phrasen in Anführungszeichen.

Query-Fan-Out: Die komplexe Anfrage wird in 3-10 Sub-Queries aufgeteilt. Dies ist das Default-Verhalten bei den meisten Anfragen und ermöglicht es, verschiedene Facetten eines Themas abzudecken.

Je nach System werden unterschiedliche Suchquellen angezapft:

- ChatGPT: Bing + Google + OpenAI (OAI-SearchBot)

- Gemini: Google Search Index

- Perplexity: Eigener Index + Bing

Die Systeme nutzen eine hybride Suche, die sowohl proprietäre als auch Third-Party-Quellen kombiniert, um ein möglichst breites Informationsspektrum abzudecken.

Die zurückgelieferten Suchergebnisse werden nach Relevanz neu bewertet und gerankt. Hierbei kommen verschiedene Scoring-Mechanismen zum Einsatz, darunter Reciprocal Rank Fusion (RRF) – eine Methode zur Rangaggregation, bei der Rankings aus mehreren Quellen zu einem einheitlichen Ranking zusammengefasst werden.

Dieser Schritt stellt sicher, dass die relevantesten Informationen für die finale Antwortgenerierung verwendet werden.

Im finalen Schritt synthetisiert das LLM die gesammelten Informationen zu einer kohärenten Antwort. Dabei werden die relevantesten Quellen als Citations direkt in die Antwort eingebunden, während weniger relevante Quellen als Sources separat aufgeführt werden.

Das Ergebnis: Eine generierte Antwort, die auf verifizierbaren, aktuellen Quellen basiert – nicht nur auf Wahrscheinlichkeiten.

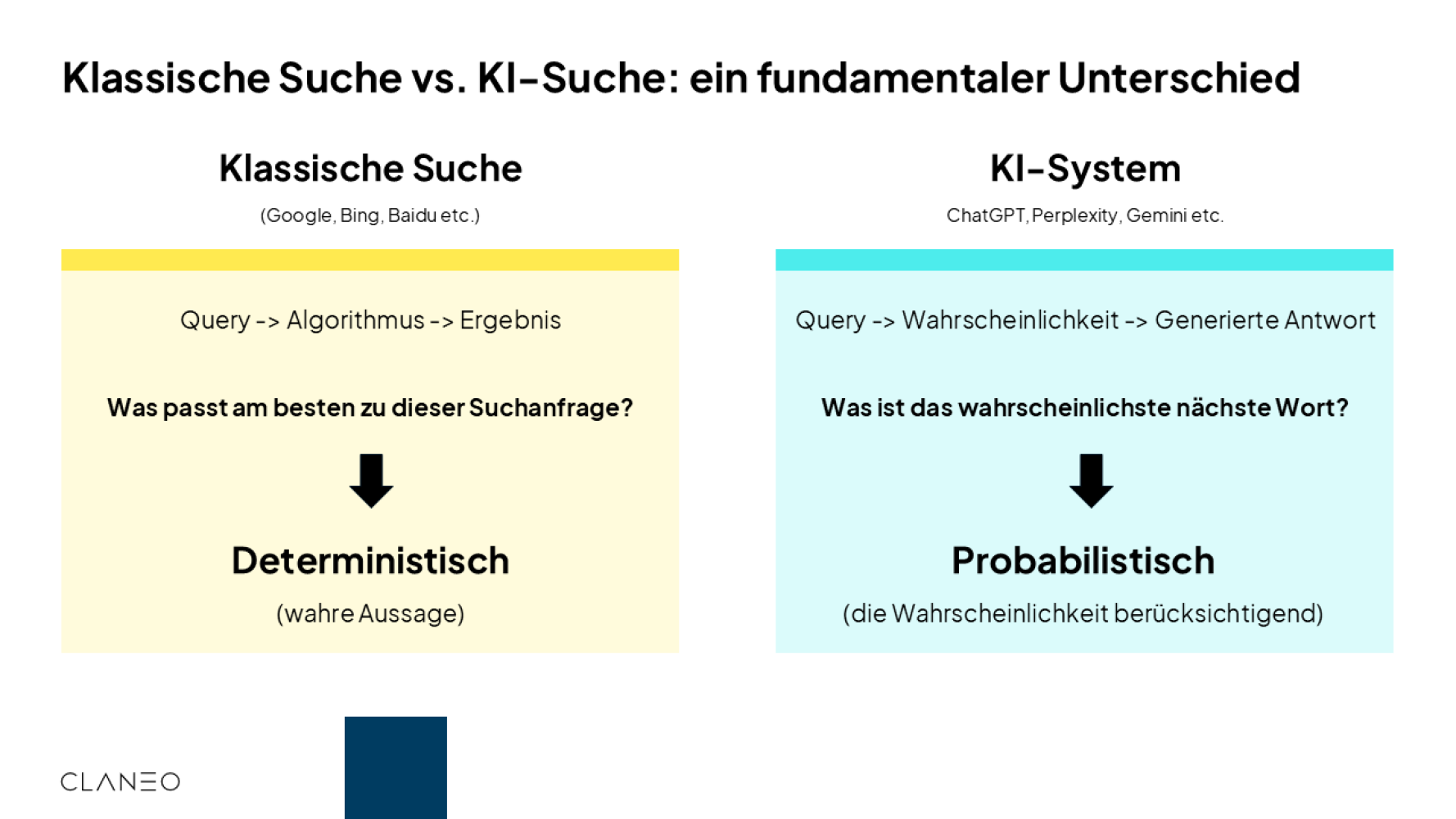

Was ist RAG (Retrieval-Augmented Generation)?

RAG ist die technische Architektur, die den Grounding-Prozess ermöglicht. Der Begriff beschreibt drei zentrale Komponenten:

Retrieval

Bezieht sich auf die Suche und den Abruf relevanter Informationen aus einer Wissensdatenbank. Oft werden hierfür Vektor-Embeddings verwendet – ein Prozess, der Daten in numerische Vektoren umwandelt, um semantische Ähnlichkeiten zu erkennen.

Augmented

Beschreibt die Erweiterung oder Anreicherung des Kontexts des LLMs mit den abgerufenen Fakten. Das Modell erhält zusätzliche, verifizierte Informationen, die seine Wissensbasis temporär erweitern.

Generation

Beschreibt den abschließenden Schritt, bei dem das LLM die endgültige Antwort basierend auf dem bereitgestellten, angereicherten Kontext formuliert. Die Antwort ist nun nicht mehr rein probabilistisch, sondern faktisch fundiert.

Query-Fan-Out in der Praxis

Ein besonders wichtiger Mechanismus für GEO-Strategien ist der Query-Fan-Out. Statt eine komplexe Anfrage direkt zu verarbeiten, zerlegt das System sie in mehrere spezifische Sub-Queries.

Beispiel: Bei der Anfrage „Welches CRM ist am besten für ein B2B SaaS Startup?“ könnte das System folgende Fan-Out-Queries generieren:

- „best CRM B2B SaaS“

- „CRM Vergleich kleine Unternehmen“

- „Hubspot vs. Salesforce vs. Pipedrive“

- „CRM Preise Start-Up“

- „CRM Integrationsmöglichkeiten“

- „CRM Datenschutz DSGVO“

- „CRM Einführung Erfahrungen“

Zweck: Verschiedene Facetten abdecken wie News, Specs, Reviews, Preise etc.

Citations vs. Sources: Der Unterschied

Bei der finalen Ausgabe unterscheiden KI-Systeme zwischen zwei Arten von Quellenangaben:

Citations: Die relevantesten Quellen, die direkt in der Antwort zitiert werden. Diese Quellen haben die höchste Relevanz und werden prominent dargestellt.

Sources: Andere Quellen, die zwar abgerufen wurden, aber nicht relevant genug sind, um in die Antwort aufgenommen zu werden. Sie werden separat aufgeführt.

Für GEO-Strategien ist es entscheidend, in den Citations zu erscheinen – nicht nur in den Sources.

Unterschiede zwischen den Systemen

Die Retrieval-Logiken unterscheiden sich je nach KI-System fundamental:

Google Gemini

Primärer Index: Google Search

Retrieval-Logik: Dynamic Retrieval Score

Query-Strategie: Query Expansion

Google AI-Mode

Primärer Index: Google Search

Retrieval-Logik: Search-by-Default

Query-Strategie: Query Expansion

OpenAI ChatGPT

Primärer Index: Proprietär (OAI-SearchBot)

Retrieval-Logik: Tool-Use Policy

Query-Strategie: Query-Fan-Out (o1)

Perplexity AI

Primärer Index: Perplexity AI

Retrieval-Logik: Search-by-Default

Query-Strategie: Multi-Stage Hybrid

GEO-Implikationen: Was bedeutet das für die Praxis?

Das Verständnis von Grounding, RAG und Query-Fan-Out ist kein Selbstzweck – es bildet das Fundament für strategische GEO-Entscheidungen.

Fokus auf Grounding-Trigger

Konzentration auf Prompts, bei denen Grounding ausgelöst wird oder die transaktional getrieben sind. Suchvolumen auf den Plattformen ist ein wichtiger Indikator.

Monitoring erfordert Wiederholung

Aufgrund der probabilistischen Art kommen immer unterschiedliche Ergebnisse – eine einmalige Abfrage ist beim Monitoring nicht repräsentativ. Mehrfache Tests sind notwendig.

Content-Lücken durch Fan-Out erkennen

Query-Fan-Out nutzen, um Content-Lücken zu identifizieren. Oftmals reichen hier auch klassische SEO-Tools, um thematische Breite zu analysieren.

Englischsprachige Inhalte bereitstellen

Wichtige Seiten auch englischsprachig anlegen. KI-Systeme ziehen oft englischsprachige Quellen heran, selbst bei deutschsprachigen Anfragen.

Quellcode-Analyse für Insights

Regelmäßig Quellcode anschauen – hier gibt es viele spannende Insights zu Retrieval-Mechanismen und Ranking-Faktoren.

Autorität wird algorithmisch bewertet

Autorität und Vertrauenswürdigkeit werden algorithmisch bewertet. E-E-A-T-Signale und Domain-Reputation beeinflussen die Quellenbewertung fundamental.

Fazit: Von Wahrscheinlichkeit zu Wahrheit

Grounding, RAG und Query-Fan-Out sind die technischen Mechanismen, die aus probabilistischen KI-Systemen faktisch fundierte Antwortmaschinen machen. Für GEO-Strategien bedeutet das:

- Content muss nicht nur für eine Query optimiert sein, sondern für mehrere Fan-Out-Queries

- Autorität und Vertrauenswürdigkeit sind entscheidend für die Quellenbewertung

- Englischsprachige Inhalte erhöhen die Chancen auf Citations

- Monitoring erfordert systematische, wiederholte Tests

- Quellcode-Analysen liefern wertvolle Insights zu Retrieval-Mechanismen

Wer diese Mechanismen versteht, kann Content gezielt so optimieren, dass er in der gesamten Bandbreite hybrider KI-Systeme performt – von ChatGPT über Gemini bis Perplexity.