Tech SEO Summit Hamburg 2026: Takeaways aus einem Tag mit geballtem Tech-SEO-Know-how

8. Mai 2026

Der Tech SEO Summit in Hamburg gehört fest in den Claneo-Kalender. Auch 2026 bot die Konferenz ein dichtes Programm an technischen Deep Dives – von KI-Crawlern und RAG-Pipelines über Netzwerkprotokolle bis hin zu Web-Fonts und automatisierten SEO-Tests. Sechs Sessions standen besonders im Fokus. Hier sind die wichtigsten Erkenntnisse.

Inhaltsverzeichnis

ToggleKI-Crawler, Logfiles und Brand-Authority – Jamie Indigo

Jamie Indigo lieferte eine der inhaltlich dichtesten Sessions des Tages. Ihre zentrale These: KI-Suche ist kein Suchsystem – sie ist ein trainiertes Modell mit Retrieval-Augmentation. KI-Plattformen funktionieren grundsätzlich anders als klassische Suchmaschinen, auch wenn sie ähnliche Mechanismen wie Crawling und Indexing nutzen. Die praktischen Konsequenzen für SEO sind erheblich.

„KI-Suche ist kein Suchsystem – sie ist ein trainiertes Modell mit Retrieval-Augmentation.“ – Jamie Indigo

Sichtbarkeit für KI-Systeme herstellen

- 85 % des KI-Referral-Traffics kommen von Plattformen, die kein JavaScript rendern. Clientseitig ausgelieferter Content wird von den meisten KI-Systemen nicht erfasst. Das bedeutet: SEO-relevante Inhalte sollten im initialen HTML verfügbar sein.

- Server-Logfiles sind die einzige verlässliche Datenquelle, um Bot-Verhalten zu verstehen – inklusive Crawl-Frequenz, Status-Codes und robots.txt-Compliance. In den Logfiles ist nachvollziehbar, ob KI-Systeme URLs halluzinieren und welche URLs sie besonders häufig aufrufen. Rufen sie immer wieder Ressourcen-URLs auf, die für sie gar nicht relevant sind (z. B. CSS- oder JavaScript-Dateien), kann man diese für KI-Crawler sperren.

- 80 % der GPT-3-Tokens stammen aus dem Common Crawl. Wer dort vertreten ist, ist auch in den Trainingsdaten vertreten. Auch Crawling durch KI-Systeme spielt eine Rolle: Wer nicht gecrawlt wird, ist nicht sichtbar.

Snippets und Zitierbarkeit sind wichtig für die Sichtbarkeit in KI-Systemen

- Snippets sind wichtig. Welche URLs von OpenAI gecrawlt werden, hängt maßgeblich davon ab, wie relevant Title und Inhalt im Snippet sind. Auch John Mueller von Google betonte die Relevanz von Meta-Descriptions für GEO.

- Zitierbare Inhalte sind verständlich, glaubwürdig und klar strukturiert. Semantisches HTML ohne JavaScript-Abhängigkeit ist dabei Pflicht. Etwa 85 % der KI-Brand-Citations stammen von Drittanbieter-Seiten.

Abb. 1: Bühne des Tech SEO Summit mit Jamie Indigo

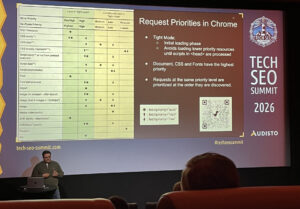

Web-Fonts und Performance – Paul Calvano

Paul Calvano, Performance Architect bei Etsy, präsentierte Daten aus dem HTTP Archive – einer monatlichen Analyse von ca. 15 Millionen Websites zum Thema Fonts, also auf Webseiten eingebundene Schriftarten. Fazit: Falsch geladene Fonts schaden direkt den Core Web Vitals und damit den Signalen für SEO. Probleme mit der Font-Einbindung wirken sich auf die User-Experience aus, denn Chrome priorisiert Fonts früh im Ladeprozess, ähnlich wie CSS.

- 89 % der Seiten laden einen Font vor dem FCP, 94,5 % vor dem LCP (basierend auf Daten aus dem HTTP Archive). Daran wird deutlich, dass eine Verbesserung hier unmittelbare Auswirkungen auf die visuelle Performance der Seite hat.

- WOFF2 verwenden: Das Format bietet die beste Komprimierung und ist damit das empfohlene Format für Web-Fonts.

- Font-Subsetting einsetzen: Nur die Zeichen laden, die tatsächlich benötigt werden – das reduziert die Dateigröße erheblich (in Calvanos Beispiel von 134 KB auf 27 KB). Wichtig ist natürlich, vorher die urheberrechtlichen Vorgaben des Font-Anbieters zu prüfen. Google Fonts unterstützt Subsetting sogar direkt über URL-Parameter.

- Fonts sollten auf der eigenen First-Party-Domain gehostet werden, mit langen Caching-Zeiten und ETags für optimales Caching.

- Preload + „font-display: swap;“ nicht kombinieren: Preload lädt Fonts früh – „swap“ stellt aber sicher, dass Text sofort mit Fallback-Font angezeigt wird. Kombiniert führt das dazu, dass Bandbreite früh für einen Font genutzt wird, der durch den Swap-Mechanismus ohnehin nicht sofort sichtbar ist.

Abb. 2: Bühne des Tech SEO Summit mit Paul Calvano

Netzwerkprotokolle, DNS und Caching-Schichten – Martin Splitt

Martin Splitt gab einen technischen Einblick in die Netzwerkinfrastruktur und deren Bedeutung für das Googlebot-Crawling – von TCP- und TLS-Handshake über HTTP-Versionen bis hin zu Service Workern und ETags.

- DNS-Änderungen brauchen Vorlaufzeit: Wer eine Migration plant, sollte die TTL („Time to Live“) frühzeitig reduzieren; so wird die alte IP-Adresse kürzer zwischengespeichert und die Änderung greift schneller. Wichtig: „TTL=0“ wird von Google ignoriert, der Mindestwert beträgt 1 Sekunde.

- Googlebot nutzt HTTP/1.1, HTTP/2 und TLS 1.3 – HTTP/3 wird aktuell nicht unterstützt: HTTP/1.1 und HTTP/2 basieren auf TCP, das Paketverluste erkennt und automatisch korrigiert. HTTP/3 setzt dagegen auf UDP, ohne diese Garantie. Gehen Pakete verloren, kann die Seite nicht vollständig geladen werden, weshalb Google es für Googlebot bislang ausschließt.

Abb. 3: Bühne des Tech SEO Summit mit Martin Splitt

Caching als strategischer Vorteil – Will Kennard

Will Kennard zeigte, dass Caching weit mehr als ein Performance-Thema ist: Caching beeinflusst Crawl-Effizienz, Indexierungskonsistenz und Business-Ergebnisse direkt. SEOs stehen dabei vor drei konkreten Entscheidungen: Wo wird der Content generiert (Server, Edge, Client)? Wo kann er gecacht werden (CDN, Edge, Browser)? Und wann soll er refresht werden? Will stellte vier Kernstrategien zum Caching vor:

- Build Time Caching: Inhalte werden einmalig beim Build generiert und statisch ausgeliefert – maximale Stabilität, minimaler Server-Load.

- TTL-basiertes Caching: Ein definierter Ablaufzeitraum steuert, wann Inhalte neu generiert werden.

- Stale-while-revalidate: Der Cache liefert zunächst den alten Stand aus, während im Hintergrund bereits revalidiert wird – ein guter Kompromiss zwischen Freshness und Performance.

- On-demand Invalidation: Gezieltes Leeren des Caches bei konkreten Content-Änderungen.

Will nannte drei typische Fehlerquellen beim Caching: Over-Caching von wichtigen, sich häufig ändernden Inhalten, Under-Caching von teuren Templates sowie defekte Invalidierungs-Logik, die dazu führt, dass veraltete Inhalte länger ausgeliefert werden als gewollt.

Abb. 4: Bühne des Tech SEO Summit mit Will Kennard

Fazit zum Tech SEO Summit in Hamburg 2026

Der Tech SEO Summit 2026 hat wieder einmal deutlich gemacht: Ein solides technisches Setup ist die Grundlage für alles andere: Crawlbarkeit, Performance, Indexierungskonsistenz und letztlich auch für Sichtbarkeit in KI-gestützten Antworten.

Die Sessions haben gezeigt, wie viele Stellschrauben es gibt und wie direkt sich technische Entscheidungen auf SEO-Ergebnisse auswirken: Die richtige Font-Strategie verbessert Core Web Vitals, saubere DNS-Konfiguration sichert Migrationen ab, und durchdachtes Caching schützt Crawl-Effizienz und Indexierungskonsistenz.

Technisches SEO ist das Fundament einer funktionierenden Optimierungsstrategie. Wer die Grundlagen beherrscht, schafft die Voraussetzung für Sichtbarkeit: in der klassischen Suche, und zunehmend auch dort, wo KI-Systeme Inhalte auswählen und zitieren.